📣 OpenAI расширяет возможности API

📣 OpenAI расширяет возможности API

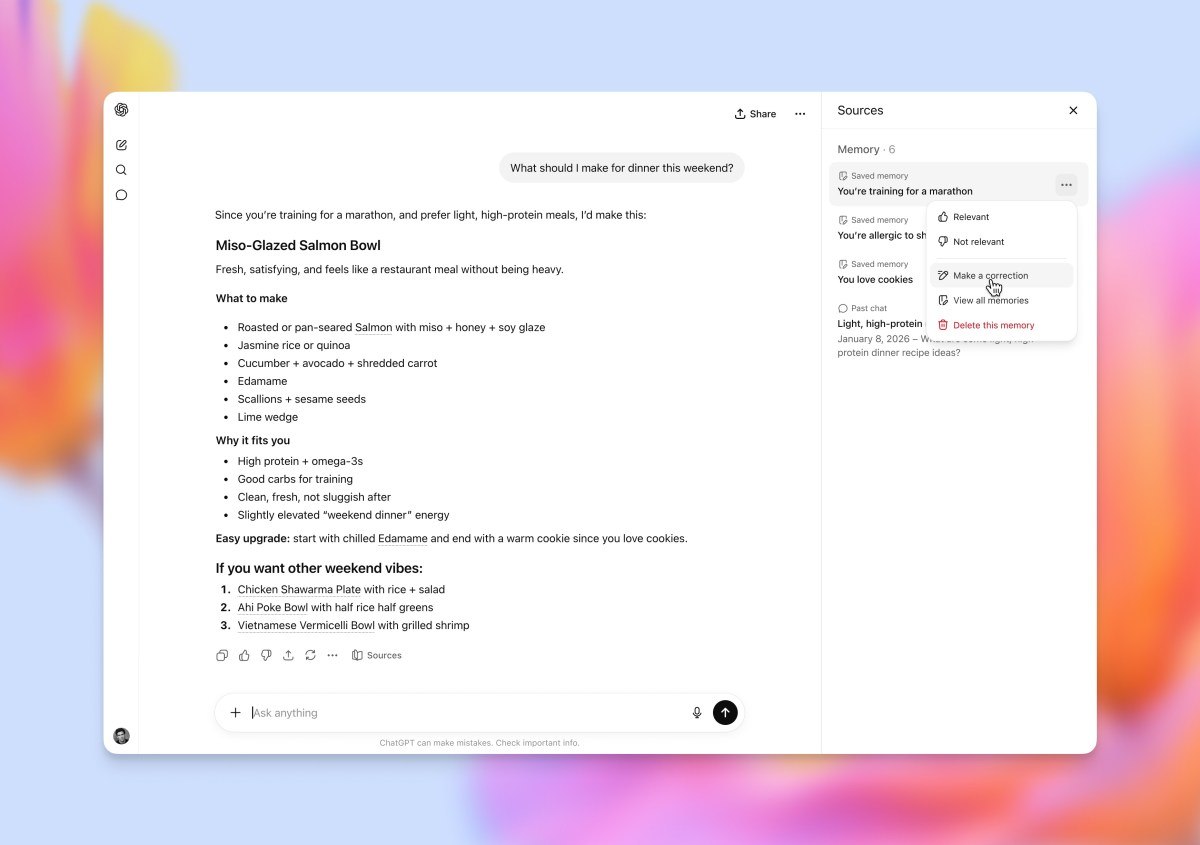

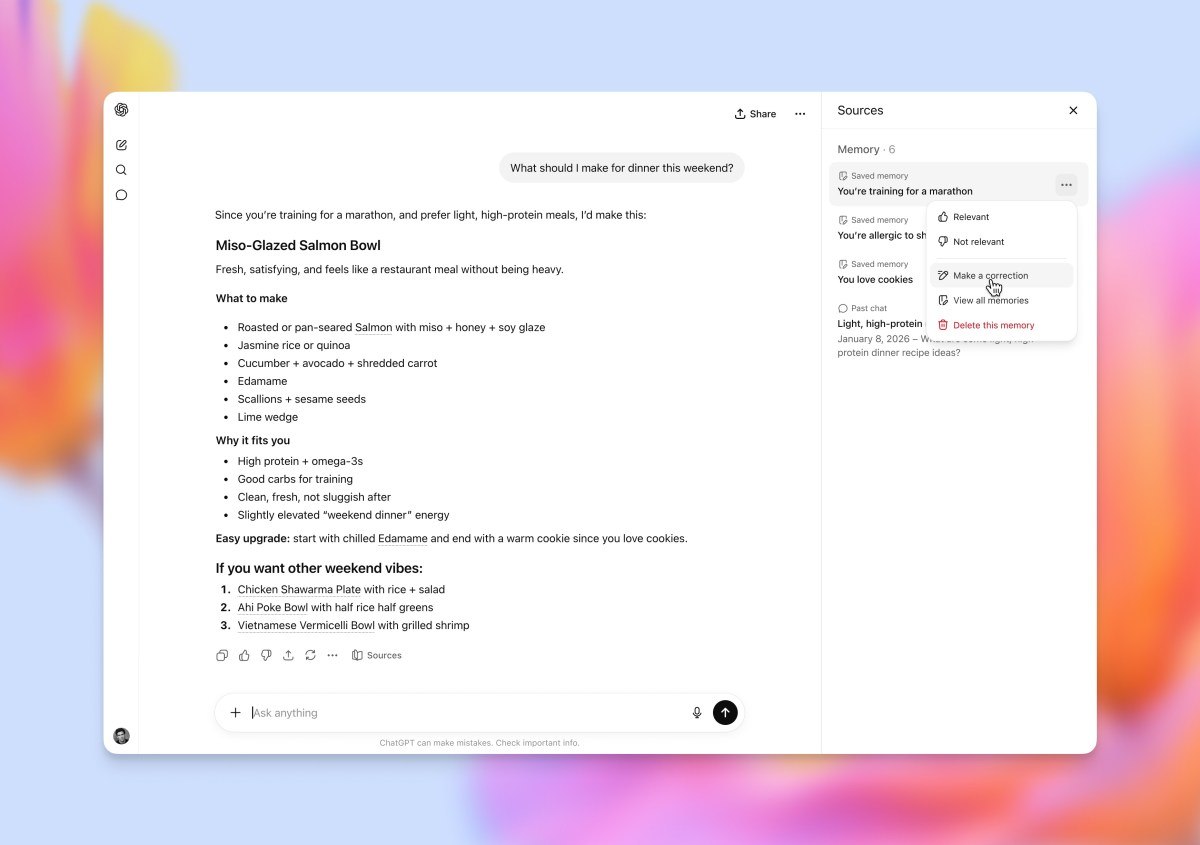

OpenAI представила новые функции голосового интеллекта в своем API. Эти обновления могут существенно изменить подход к системам обслуживания клиентов, особенно для малого бизнеса, который стремится улучшить взаимодействие с клиентами.

Рынок реагирует позитивно, видя в этом шаге потенциал для улучшения клиентского сервиса.

AI-инструменты становятся ключевыми для оптимизации бизнес-процессов.

OpenAI добавила функции, которые позволяют бизнесам интегрировать более продвинутые голосовые возможности в свои системы. Это может снизить затраты на поддержку и повысить удовлетворенность клиентов. Малый бизнес теперь может использовать AI не только для автоматизации, но и для создания более персонализированного опыта.

→ Источник ⚖️ OpenAI выпускает GPT-5

⚖️ OpenAI выпускает GPT-5.5 Instant

OpenAI представила новую модель GPT-5.5 Instant, которая делает работу с текстами в праве и медицине более точной. Это может стать значительным улучшением для малых бизнесов, которые используют AI для обработки информации в этих сферах.

Рынок уже проявляет интерес, ожидая снижения ошибок в критически важных задачах.

AI становится более надёжным инструментом для бизнеса.

GPT-5.5 Instant разработана с учётом потребностей в точности и снижении ошибок в чувствительных областях. Это особенно важно для малых бизнесов, работающих с юридическими и медицинскими текстами, где ошибки могут привести к серьёзным последствиям. Интеграция такой модели может повысить доверие клиентов и оптимизировать внутренние процессы.

→ Источник 🤖 Барри Диллер: «Доверять Олтмену можно, но ИИСИ — это уже не про доверие»

Известный инвестор Барри Диллер заявил, что доверяет главе OpenAI Сэму Олтмену, однако подчеркнул, что с приближением эры Искусственного Общего Интеллекта (ИОИ) понятие личного доверия теряет актуальность. Он призвал сосредоточиться не на персоналиях, а на создании абсолютно надежных «ограничителей» и систем безопасности для этой непредсказуемой технологии, способной изменить мир.

#ИскусственныйИнтеллект #OpenAI #БезопасностьИИ 💬💬 Claude и GPT научились слушать буквально

💬💬 Claude и GPT научились слушать буквально. Старые промпты больше не работают

Anthropic и OpenAI почти одновременно выкатили свежие гайды по промптингу.

💬 Claude 4.7 стал буквальным. Делает ровно что написано и больше не достраивает за тебя. Раньше скажешь "поправь этот раздел" и Claude мог поправить и соседние, потому что догадался. Теперь нет. По бенчмаркам прирост приличный (SWE-Bench 87.6% против 80.8% у 4.6), но ощущение у пользователей одно: "стало хуже".

Глава Claude Code Борис Черни прямо написал —

понадобилось несколько дней чтобы научиться с ним работать.

Что делать: явно прописывай область действия. Не "поправь форматирование", а "поправь форматирование во всех разделах кроме первого". Догадываться модель больше не будет.

🤖 GPT-5.5 пошёл в обратную сторону — в автономию. Описываешь шаги детально — модель шумит и выдаёт механический ответ. OpenAI прямо пишет: опиши результат, критерии успеха и ограничения, но не описывай путь. Пусть модель сама выберет инструменты и последовательность.

Что делать: вместо процесса — описание результата. Не "сначала найди X, потом сравни с Y", а "цель такая, успех это когда выполнено A B C, ограничения такие". OpenAI ещё рекомендует мигрировать не правкой старых промптов, а с чистого листа, старая структура только мешает.

Парадокс в том, что обе модели стали буквальными, но в разном смысле. Claude — буквальный к словам ("сделай ровно это и ничего больше"). GPT — буквальный к цели ("дойди до результата как угодно, но дойди"). Расплывчатость ненавидят обе.

Практический вывод для тех кто строит продукты на этих API: две минуты на формулирование того, как выглядит "успех", окупаются больше чем час полировки промпта.

🔗 Гайд от Claude

🔗 Гайд от OpenAI

🤖 В эпоху AI 🤖 Cerebras, ключевой партнер OpenAI, готовится к громкому IPO с оценкой в $26,6 млрд

Компания Cerebras Systems, создающая уникальные чипы для обучения больших языковых моделей, выходит на финишную прямую перед IPO. Предполагаемая оценка может достичь $26,6 млрд. Её успех во многом связан с прочным стратегическим альянсом с OpenAI, для которой Cerebras разрабатывает мощные вычислительные решения. Это размещение станет одним из самых значимых событий на рынке полупроводников для ИИ, подчеркивая растущий спрос на специализированное аппаратное обеспечение.

#Cerebras #IPO_2024 #ИИ_чипы 🤖 Единственный эксперт по ИИ Маска на суде с OpenAI предупреждает о гонке вооружений ИИГ

Стюарт Рассел, один из авторов ключевого учебника по ИИ, выступил в суде как эксперт со стороны Илона Маска. Он выразил серьёзную озабоченность, что гонка между такими компаниями, как OpenAI, в создании ИИГ может привести к опасной спирали, аналогичной ядерной гонке вооружений. По мнению Рассела, для предотвращения непредсказуемых рисков государствам необходимо установить чёткие международные рамки и ограничения для "пограничных" AI-лабораторий, работающих на пределе возможностей.

#ИскусственныйИнтеллект #РегулированиеИИ #ИИГ Маск против Альтмана: кто на самом деле кого «кинул»?

В суде идёт процесс, который называют главным скандалом десятилетия.

Маск обвиняет Альтмана и Брокмана в том, что они превратили некоммерческую лабораторию в коммерческого монстра.

«Нельзя красть благотворительную организацию» — говорит Маск с трибуны. Адвокаты OpenAI отвечают: «Этот иск мотивирован завистью человека, который хотел быть на вершине и не оказался там»

……

Маск сам инициировал OpenAI и публично пообещал вложить $1 млрд. Под эту идею собрались люди, которые точно не нуждались в деньгах: Альтман вложил около $10 млн, Рид Хоффман — сопоставимую сумму, Брокман отказался от нескольких миллиардов в опционах ради участия в проекте. Люди шли не за прибылью — шли делать что-то важное, великое.

Обещанного миллиарда в полном объёме так и не появилось. Зато появились требования: по имеющимся данным, Маск настаивал на слиянии OpenAI с Tesla и установлении личного контроля над компанией. Получил отказ — покинул совет директоров. В итоге его суммарные пожертвования составили около $38 млн — из обещанного миллиарда.

Стало очевидно, что даже за миллиард AGI не построишь: нужны десятки миллиардов, прежде всего на вычислительные мощности.

Альтман создал коммерческую дочернюю структуру при сохранении некоммерческого «родителя» как управляющей надстройки — единственная схема, способная привлечь реальные деньги. Microsoft зашла сначала с $1 млрд в 2019-м, затем довела общий объём инвестиций до $13+ млрд. Остальное известно.

Маск тем временем основал xAI и несколько лет строит Grok — конкурента ChatGPT. Пока догоняет.

Сейчас он требует через суд до $134 млрд компенсации, отставки Альтмана и полной отмены реструктуризации. Для OpenAI, которая готовится к IPO с оценкой около $1 трлн, исход этого дела действительно критичен.

Можно уважать принципиальную позицию о некоммерческой миссии ИИ — это серьёзная тема. Но сложно не заметить весь контекст: человек, не выполнивший собственное обещание, требует сотни миллиардов с тех, кто нашёл деньги и довёл проект до триллиона. Это не похоже на защиту человечества. Это похоже на что-то другое.

А вы на чьей стороне? 👇 🤖 OpenAI и Yubico усиливают защиту ChatGPT: представлены аппаратные ключи безопасности

OpenAI усиливает безопасность платформы ChatGPT, представив дополнительные опциональные методы защиты для учётных записей. Ключевым элементом инициативы стало партнёрство с лидером в области аппаратной безопасности — компанией Yubico. Пользователи смогут использовать физические ключи безопасности YubiKey для двухфакторной аутентификации, что значительно повысит защиту от несанкционированного доступа и фишинговых атак. Это решение направлено на корпоративных клиентов и пользователей, работающих с конфиденциальными данными.

#OpenAI #Кибербезопасность #YubiKey 🤖 OpenAI ограничивает доступ к GPT-4o Cyber вслед за критикой в адрес Anthropic

Компания OpenAI объявила о поэтапном запуске своего нового инструмента для тестирования кибербезопасности — GPT-4o Cyber. На первом этапе доступ к нему получат только «критически важные киберзащитники». Это решение выглядит особенно ироничным на фоне недавней критики со стороны OpenAI в адрес Anthropic, которая ограничила доступ к своей модели безопасности Mythos. Таким образом, OpenAI, ранее упрекавшая конкурента за излишнюю избирательность, теперь сама следует аналогичной стратегии контролируемого релиза.

#GPT4o #Кибербезопасность #ИИЭтика