🚩 Красный флаг в ML: у вас слишком хорошая модель

Вы натренировали свою первую модель. Вывели метрики. Там R2 стремится к 0.99.

Что делает типичный новичок? Радуется, бежит к заказчику требовать премию и просит выкатывать это чудо в прод.

Что делает человек с опытом? Седеет, нервно пьет кофе и идет искать, где у него утечка данных.

В реальном мире идеальных метрик почти не бывает. Если ваша модель угадывает всё, значит она читерит. Модель должна работать на новых, невиданных ранее данных. А для этого нужно понимать логику валидации, а не просто по привычке копипастить train_test_split.

Вот такие вещи мы будем изучать в новом сезоне Мастер-группы по ML. В программе:

🟢 5 эфиров: от самых азов машинного обучения до построения и валидации базовых линейных моделей.

🟢 1 эфир — командная практика. Хватит просто смотреть лекции. Будете в командах решать практическую задачу, а потом мы все вместе будем разбирать результаты (и смотреть, кто где накосячил).

🟢 Записи и мои файлы с кодом, естественно, остаются у вас. Забираете и используете как шпаргалку в работе.

🗓 Первый эфир уже завтра в 11:00 по мск.

Для тех, кто долго запрягает — двери еще приоткрыты. Если интересно, пишите в личку @obulygin91 ◀️

🤡 Как завалить технический собес в ML за 3 минуты

🤡 Как завалить технический собес в ML за 3 минуты

Приходит кандидат на джуна или даже мидла. Его спрашивают про стек — там полный фарш, человек разве что свой Claude на домашних видеокартах не обучал.

Дают ему простейшую задачку на линейную регрессию. Человек радостно импортирует scikit-learn, пишет .fit(), затем .predict(). Занимает ровно 20 секунд. Доволен.

А дальше ему начинаю задавать вопросы:

— А почему ты для оценки качества взял MSE, а не R2?

— У нас в датасете есть жирный выброс. Как твоя модель на него отреагирует и почему?

— Что означает вон тот коэффициент при признаке X, если мы его не отнормировали?

И тишина... Человек знает API библиотеки, но в душе не чает, как работает все под капотом.

Инструменты вроде sklearn создавались умными людьми для умных людей, чтобы экономить время на рутине. А не для того, чтобы кто-то мог скрыть отсутствие фундаментальной базы за двумя строчками кода. Алгоритму плевать на ваши данные, он сожрет любой мусор, который вы в него запихнете, и выдаст вам предсказание. Garbage in — garbage out.

Вот такие основы мы и начнем изучать на следующем сезоне Мастер-группы. В программе:

🟢 5 эфиров: от азов машинного обучения до построения и валидации базовых линейных моделей.

🟢 1 эфир — командная практика. Хватит просто смотреть лекции. Будете в командах решать практическую задачу, а потом мы все вместе будем разбирать результаты (и смотреть, кто где накосячил).

🟢 Записи и мои файлы с кодом, естественно, остаются у вас. Забираете и используете как шпаргалку в работе.

🗓 Напоминаю, что стартуем 25 апреля в 11:00 по мск. Вы уже должны уметь в Python и pandas.

👉 Если хотите перестать быть fit-predict макакой — пишите в личку @obulygin91, расскажу детали.

Классическое машинное обучение мертво?

⚰️

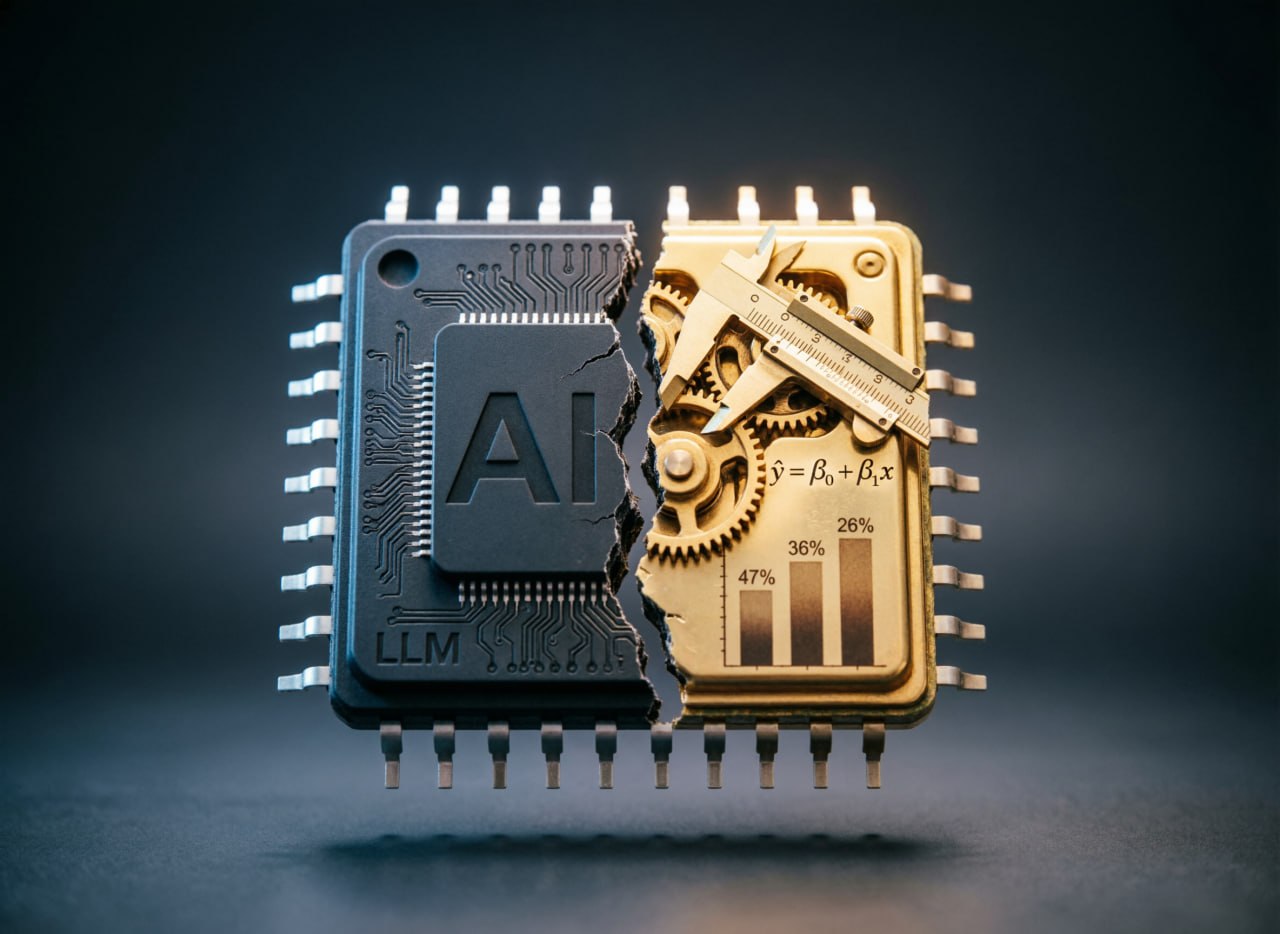

Из каждого утюга сейчас вещают, что если ты не обучаешь LLM с миллиардами параметров, то ты не в профессии, а линейные регрессии пора сдать в музей.

А теперь открываем аналитику от airesearchtrends по инструментам, которые реально используются в современных ML-пайплайнах:

🟢 Classical ML — 47%

🟢 Neural Networks — 36%

🟢 Ensemble Methods — 26%

🟢 Clustering — 4%

Почти половина реального ресерча и продакшена строится на классическом ML. Потому что там, где нужна интерпретируемость, предсказуемость и надежность, раздутые нейронки проигрывают грамотно настроенной модели. А вот массовый рынок почему-то решил, что если ты научился дергать API OpenAI, то математику под капотом можно уже не понимать. Спойлер: нельзя.

Собственно, именно поэтому следующий сезон Мастер-группы мы посвящаем фундаментальной базе. Переходим от анализа данных к построению моделей.

🗓 Стартуем 25 апреля. Эфиры будут проходить по субботам в 11:00 по МСК.

Что в меню:

🟢 5 эфиров: от самых азов машинного обучения до построения и валидации базовых линейных моделей.

🟢 1 эфир — командная практика. Хватит просто смотреть лекции. Будете в командах решать практическую задачу, а потом мы все вместе будем разбирать результаты (и смотреть, кто где накосячил).

🟢 Записи и мои файлы с кодом, естественно, остаются у вас. Забираете и используете как шпаргалку в работе.

Так как Телеграму в последнее время, к сожалению, плохо, то закрытая группа будет в ВК.

🐍 Важный фильтр:

Это не курс "с нуля до сеньора за два дня". Вы уже должны адекватно писать на Python, крутить датафреймы в pandas и уметь в базовый анализ данных (всё то, что мы выстрадали на первых двух сезонах).

👉 Кому актуально запрыгнуть в этот вагон и узнать условия, пишите в личку: @obulygin91

Как Яндекс внедрял QoS в InfiniBand для ML‑кластеров 🚦🧠

Как Яндекс внедрял QoS в InfiniBand для ML‑кластеров 🚦🧠

Яндекс поделился практическим опытом, как они научились приоритизировать ML-трафик в InfiniBand‑сетях GPU‑кластеров, чтобы важные задачи не «проседали» по скорости из‑за соседних запусков.

Ключевые моменты:

InfiniBand использует централизованный Subnet Manager (OpenSM), который управляет адресацией, маршрутизацией и QoS‑политиками через связку Service Level (SL) и Virtual Lanes (VL).

QoS строится так: трафик разных типов «красят» в разные SL, которые маппятся в VL с разным приоритетом и весами; в тестовой схеме SL1 получает 80% полосы, SL0 — 20%.

В кластерах YATI несколько обучений разных пользователей делят одну InfiniBand‑фабрику, поэтому без QoS крупные и критичные обучения легко «топятся» параллельными задачами.

На FatTree‑кластерe с HDR они сначала не увидели эффекта, пока искусственно не создали переподписку (отключили часть spine‑коммутаторов), после чего трафик SL1 реально начал выдавливать SL0 при конкуренции.

В DragonFly+ всё сложнее: там маршрутизация использует разные VL для прямого пути и +1/+3 hop, чтобы избежать credit loop deadlock в lossless‑сети, поэтому SL→VL‑маппинг становится частью Control Plane, а доступное число «красок» фактически сокращается.

В итоге Яндекс превратил QoS в продуктовый механизм: планировщик обучения помечает крупные обучения (по порогу GPU на кластер, настраиваемому для каждого кластера) как приоритетные, агент на хосте перекрашивает их трафик в SL1, остальные идут в SL0 — даже если пользователь пытался проставить свои SL.

Дальше этот же подход планируют использовать для разведения обучения и мультихостового инференса, отдавая приоритет real‑time‑инференсу по сети.

QoS в InfiniBand — это не просто «очереди на порту», а тесная связка с топологией и routing engine (особенно в DragonFly+), иначе легко получить либо отсутствие эффекта, либо ризик deadlock’ов.

#yandex #infiniband #qos #gpu #ml #mlops #networking #dragonflyplus #cloud #infrastructure