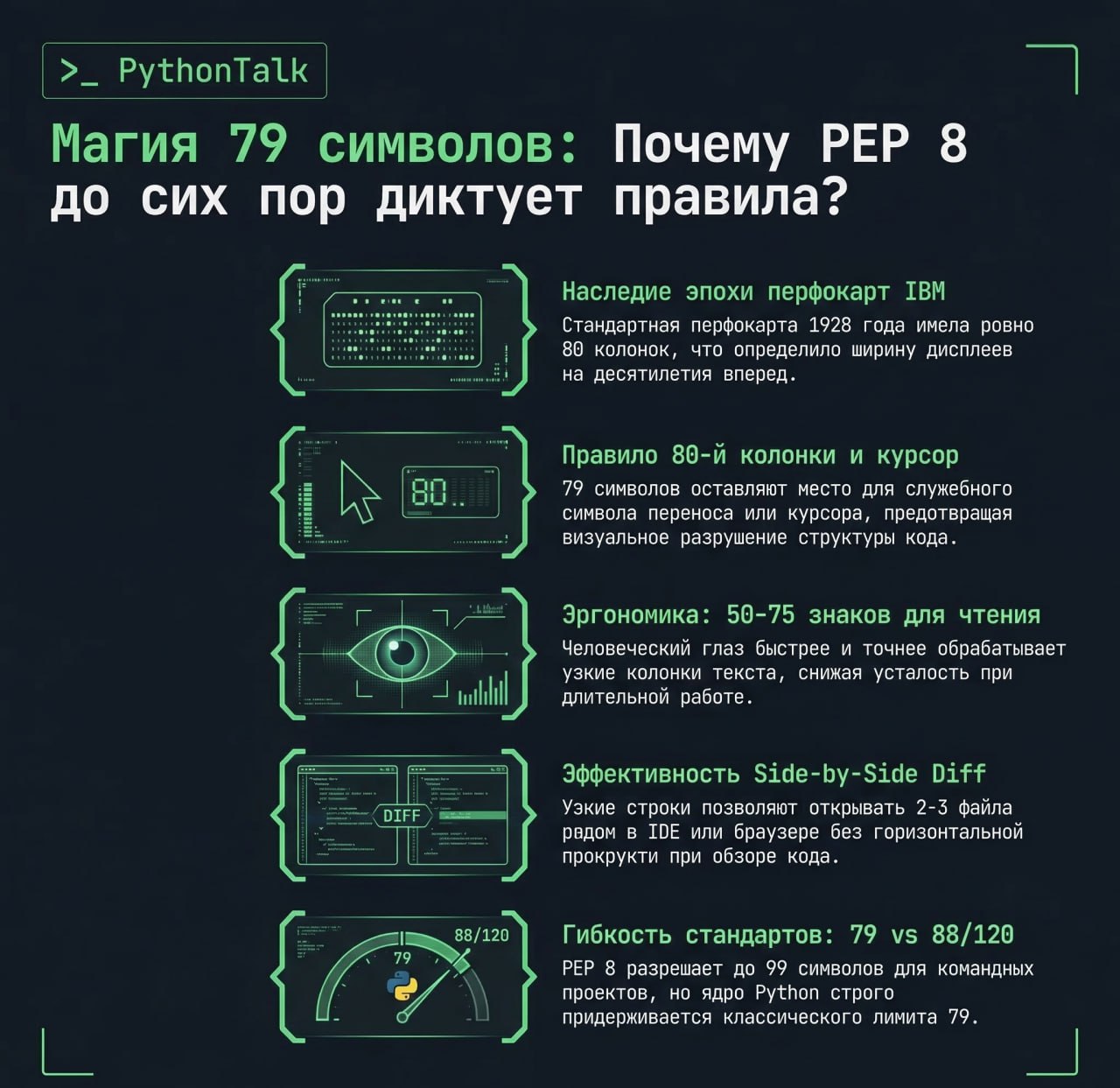

79 символов: архаизм или инженерный дзен?

Каждый, кто хоть раз видел, как линтер (или коллега с синдромом вахтёра) подсвечивает красным 80-й символ, задавался вопросом: мы до сих пор живём в 1970-х?

Спойлер: отчасти да.

👻 Призраки прошлого

Перфокарты IBM на 80 колонок — это "легаси" в самом чистом виде. Мы давно не пробиваем дырки в картоне, но наши инструменты до сих пор живут в рамках этих ограничений. Это тот случай, когда форма определила содержание на десятилетия вперёд.

🛠 Почему это всё ещё актуально:

1. Side-by-side diffs. Когда вы открываете два файла в IDE рядом (или в GitHub/GitLab), узкие строки позволяют видеть код без постоянного скролла влево-вправо. Если у вас "портянка" на 200 символов, то уже неудобно.

2. Когнитивная нагрузка. Узкие блоки кода читаются быстрее. Глаз меньше скачет по строке. Внимательный разраб заметит баг быстрее, если код не "размазан" по ширине вашего 32-дюймового монитора.

В реальности всё прагматичнее:

🔵Если вы используете Black (а вы должны его использовать), он по умолчанию ставит 88. Это золотая середина между "классикой" и реальностью современных мониторов.

🔵Если вы работаете в команде, где в конфигах flake8 прописано 120 символов — окей, ставьте 120. Главное — чтобы это было единообразно.

В общем, не фанатейте от 79 символов ради самих 79 символов. Но и не пишите колбасы на полтора экрана. Хороший код должен быть читаемым, а не длинным.

#так_сложилось